告别AI视频“流水账”:腾讯混元MTSS如何重塑视频生成范式

type

status

date

slug

summary

tags

category

icon

password

网址

引言:AI视频创作的“剧本困境”

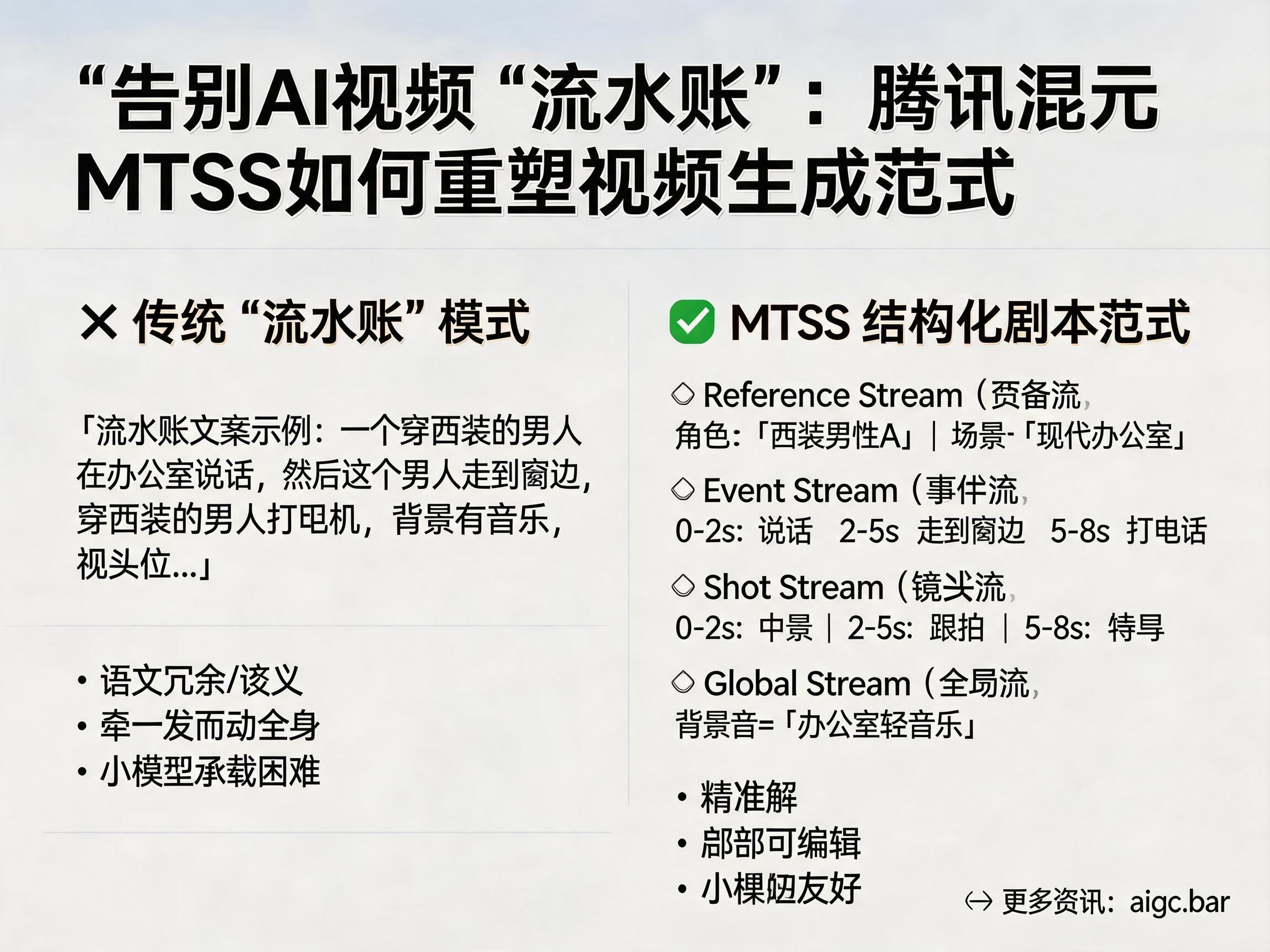

在人工智能飞速发展的今天,视频生成模型已经能够创造出令人惊叹的视觉效果。然而,当开发者试图实现多分镜、ID保持以及音画同步等复杂功能时,往往会遭遇一个被忽视的瓶颈:描述视频的语言范式。当前主流的“流水账”式描述(Monolithic Caption)将视觉、听觉、动作等所有信息揉成一段文字,这不仅让模型难以理解,更限制了视频生成的精确控制。腾讯混元团队提出的 MTSS(Multi-Stream Scene Script),正是为了打破这一僵局,通过引入“结构化剧本”范式,为AI视频领域开辟了新的技术路径。

为什么“流水账”成了AI的绊脚石

长期以来,AI视频模型依赖于海量的自然语言段落来学习视频内容。这种方式存在三个核心痛点:

- 语义冗余与歧义:在长视频中,角色身份在不同镜头间反复出现,传统的描述方式极易导致身份引用混乱。模型无法判断多个“穿西装的男人”是否为同一角色,导致生成结果串联失败。

- 可扩展性极差:如果用户想要修改视频中的局部细节(如更换背景音乐或微调镜头运动),在“流水账”模式下,往往需要重写整段描述,这种“牵一发而动全身”的特性极大降低了创作效率。

- 对小模型极不友好:密集的信息流增加了认知负担。对于7B级别的轻量化模型,这种复杂的描述方式往往导致理解能力断崖式下跌,限制了模型在边缘侧的部署潜力。

MTSS:让AI像导演一样思考

MTSS(Multi-Stream Scene Script)的核心逻辑在于:不再写散文,而是写剧本。 它将视频描述拆解为四个并行的信息流,通过这种结构化设计,实现了对视频内容的精确解耦。

- Stream Factorization(流分解):MTSS将视频拆分为Reference Stream(资产信息)、Event Stream(事件信息)、Shot Stream(镜头信息)和Global Stream(全局信息)。这种解耦方式使得模型能够清晰分辨“谁在什么场景下做了什么”,极大地降低了学习难度。

- Relational Grounding(关联锚定):为了让四条流“活”起来,MTSS通过身份锚定和时间锚定,确保了全局的逻辑一致性。这意味着当你在“事件流”中修改对话时,不会影响“镜头流”中的运镜轨迹,实现了真正的局部编辑与全局一致。

从理解到生成:MTSS的实战红利

MTSS不仅是一种数据格式,更是一个强大的“认知脚手架”。在视频理解任务中,使用MTSS范式的数据能够显著提升模型在推理任务上的表现,尤其是在参数规模较小的模型中,效果提升尤为明显。

在视频生成领域,以LTX-2等开源模型为例,引入MTSS后,模型展现出了更强的控制力:

1. 多分镜精准控制:通过Shot时间戳,模型能够准确捕捉分镜转换点。

2. ID身份保持:通过跨镜头的Reference Grounding机制,解决了角色在不同场景下“变脸”的问题。

3. 音画同出:MTSS明确了“说什么”和“怎么说”,将音频生成从随机的环境噪声转化为语义正确的对话指令。

结语:迈向视频生成的“剧本时代”

腾讯混元团队的MTSS工作有力地证明了,在当前大模型环境下,数据工程的优化往往比单纯的架构微调更具红利。通过告别“流水账”,我们正在进入一个视频生成的专业化工业级工作流时代。

随着AI技术的持续演进,如何高效地驾驭模型、实现更精准的可控生成已成为行业焦点。想要第一时间掌握大模型、LLM以及人工智能领域的最新资讯与实战技巧,欢迎访问 AI门户,获取更多深度分析与前沿动态。无论是提示词(Prompt)工程还是大模型API调用,这里都有你需要的一切。

Loading...

.png?table=collection&id=cbe6506e-1263-8358-a4d7-07ce62fcbb3f&t=cbe6506e-1263-8358-a4d7-07ce62fcbb3f)